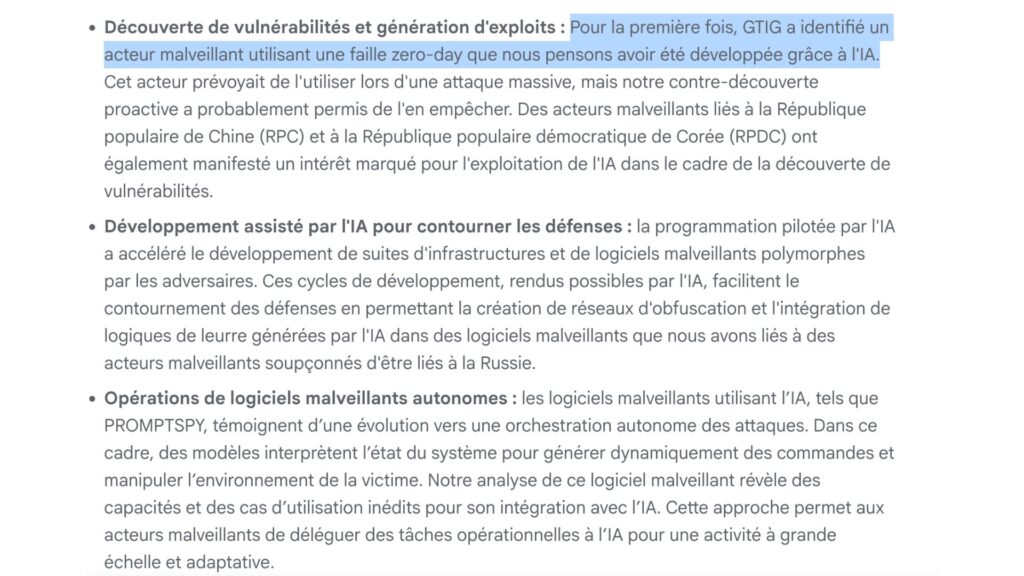

Nous y sommes : Google affirme avoir détecté une faille de sécurité « zero-day » développée avec l’aide de l’IA. Dans un rapport publié le 11 mai 2026 — qui synthétise ses observations sur l’usage de l’IA dans les menaces cyber –, le géant américain évoque une découverte particulièrement marquante.

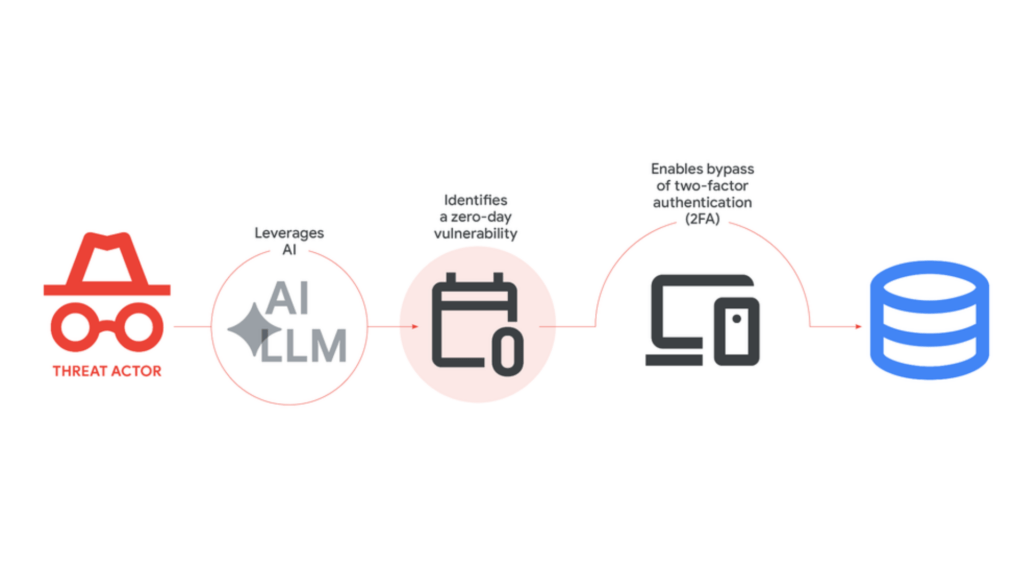

Concrètement, un groupe de cybercriminels aurait utilisé l’IA pour développer un exploit zero-day capable de contourner l’authentification à deux facteurs (2FA) d’un outil web open source d’administration système. L’exploit aurait ensuite été intégré à un script Python. Une évolution qui illustre le rôle grandissant de l’intelligence artificielle dans les opérations offensives menées par les cybercriminels.

Comment des hackers ont-ils utilisé l’IA pour développer un exploit zero-day ?

Pour rappel, les zero-day sont des failles encore inconnues des éditeurs, qui permettent aux hackers de mener des attaques sophistiquées contre des logiciels ou des services.

Plus précisément, une vulnérabilité zero-day désigne une faille qui n’a pas encore été identifiée, documentée ou corrigée par son développeur. L’exploit zero-day, lui, correspond au code ou à la méthode permettant d’exploiter cette faille avant la publication d’un correctif. Le terme renvoie au fait que l’éditeur dispose de « zéro jour » de marge entre la découverte de la vulnérabilité et son exploitation dans la nature.

Jusqu’ici, les exploits zero-day étaient surtout le fruit de chercheurs humains très spécialisés, capables de faire de la rétro-ingénierie, du fuzzing ou encore de l’audit de code avancé pour dénicher des vulnérabilités inédites. En théorie, les spécialistes savaient déjà que l’IA pouvait aider à analyser du code, rechercher des failles ou générer des preuves de concept (PoC) d’exploit.

Mais jusqu’à présent, aucun cas publiquement documenté par un acteur majeur comme Google n’avait montré l’implication directe d’un grand modèle de langage (LLM) dans le développement d’un exploit zero-day réellement observé dans une attaque.

Si le groupe de pirates informatiques et l’outil ciblé n’ont pas été nommés, Google indique avoir collaboré avec l’éditeur concerné afin d’empêcher une exploitation massive de la faille, qui semblait être l’objectif des attaquants.

« Bien que nous ne pensions pas que Gemini ait été utilisé, compte tenu de la structure et du contenu de ces exploits, nous sommes presque certains que l’acteur a probablement exploité un modèle d’IA pour faciliter la découverte et l’utilisation de cette vulnérabilité », explique Google.

L’entreprise pointe notamment plusieurs indices typiques de code généré par IA : une documentation particulièrement verbeuse, un score CVSS falsifié, un script Python très propre avec des menus d’aide détaillés, ainsi qu’une petite classe dédiée aux couleurs ANSI dans le terminal. Un ensemble bien plus caractéristique d’un code produit par un LLM que d’un exploit traditionnellement écrit à la main par des cybercriminels.

Comment la double authentification a-t-elle été contournée ?

Dans son rapport, Google explique par ailleurs que la faille ne repose pas sur un bug technique classique, mais sur une erreur dans la logique même du système d’authentification. En pratique, l’application considérait qu’un utilisateur possédant déjà des identifiants valides était forcément digne de confiance. Résultat : dans certains cas, il devenait possible de contourner l’étape de double authentification (2FA).

Ce type de vulnérabilité est particulièrement difficile à détecter avec les outils de sécurité traditionnels, car le code fonctionne techniquement comme prévu. Le problème vient plutôt d’une incohérence dans les règles de sécurité. C’est précisément là que les modèles de langage peuvent se montrer utiles : capables d’analyser la logique globale d’un programme, ils peuvent identifier des comportements qui paraissent cohérents pour la machine, mais qui ouvrent en réalité une faille exploitable.

Dans son rapport, Google explique qu’il s’agit de la première fois que ses équipes identifient un usage réussi de l’IA pour développer une vulnérabilité zero-day. Sans prétendre être exhaustive, l’entreprise souligne surtout qu’il s’agit, pour elle, du premier cas où elle peut documenter de manière aussi claire le rôle joué par un modèle d’IA.

Plus largement, le rapport décrit comment des groupes liés à la Chine ou à la Corée du Nord intègrent déjà l’IA dans leurs outils offensifs : agents spécialisés pour la phase de reconnaissance et l’analyse de code, jailbreaks « persona » pour rechercher des failles dans des firmwares, ou encore envois massifs de requêtes à des modèles afin d’analyser des CVE (Common Vulnerabilities and Exposures) et valider des exploits. Dans ce contexte, l’IA apparaît moins comme un gadget expérimental que comme une nouvelle brique intégrée à des chaînes d’attaque déjà largement industrialisées.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Pour ne rien manquer de l’actualité, suivez Numerama sur Google !