Le 15 mai 2018, Facebook a lancé une communication massive en Europe, tenant des forums dans les grandes capitales du continent pour s’ouvrir sur sa politique de modération. L’événement entre dans une stratégie du réseau social américain qui cherche à apporter plus de transparence à ses différents pôles. Que cette soudaine volonté d’ouverture soit liée à l’affaire Cambridge Analytica, au RGPD, ou à une prise de conscience à la suite des événements de 2016 autour des fake news, nul ne peut l’affirmer avec certitude. Quoi qu’il en soit, aujourd’hui, Facebook s’est engagé dans cette voie et il sera difficile de faire moins à l’avenir que ce qui est proposé maintenant.

Avec la presse et des invités, étudiants et professionnels, Facebook s’est donc prêté à l’exercice de la transparence sur ses activités de modération. Elles sont aujourd’hui une part très importante du réseau social qui doit composer avec 2 milliards d’utilisateurs, autant de lois qu’il y a de pays et de sensibilités qu’il y a d’opinion. La publication en début d’année 2018 des règles de la communauté était une première étape vers cette nécessaire transparence : on peut ne pas être d’accord avec certaines règles, mais on sait au moins, aujourd’hui, ce sur quoi Facebook se base quand il décide de supprimer, ou non, un contenu.

De l’automatique, de l’humain… et bientôt de l’IA

Sur le réseau social, la modération est opérée à plusieurs niveaux.

- Le premier est automatique et concerne les contenus pédopornographiques ou terroristes. Pour Monika Bickert, directrice du pôle à l’international pour Facebook, la majorité de ces contenus sont au fond très facilement identifiables, puisqu’ils circulent sur Internet. Facebook va alors associer une image interdite « connue » à un « hash », c’est-à-dire une identifiant unique qui correspond à ses caractéristiques. Dès qu’un utilisateur cherche à téléverser une image déjà dans la base de données (par exemple la scène d’une décapitation), Facebook va la supprimer automatiquement.

- Le second implique des modérateurs et c’est aujourd’hui le plus difficile. Ils sont 7 500 dans le monde aujourd’hui à devoir juger de contenus remontés massivement par les utilisateurs ou identifiés comme problématiques sur la plateforme. Ces modérateurs se réfèrent aux règles de la communauté, mais sont souvent pris au dépourvu dans des situations où le contexte change tout. Un « bitch » américain n’a pas le même sens s’il s’agit d’un échange entre deux adolescentes utilisant l’argot ou d’une insulte misogyne utilisée par un homme dans une campagne de cyberharcèlement. Dans les cas les plus difficiles à juger, ces modérateurs vont travailler avec des associations locales et parfois les autorités pour juger d’un contenu. Si un consensus est fait, une jurisprudence peut même établir de nouvelles règles de la communauté : elles sont renouvelées et mises à jour toutes les deux semaines.

- Le troisième, c’est l’avenir : Facebook entraîne des intelligences artificielles pour régler les problèmes de modération avec plus d’efficacité. Mais l’entraînement prend du temps et il faut une quantité de données colossales à une IA pour qu’elle sache repérer, dans l’exemple précédent, lequel des deux bitch est contraire aux règles de la communauté. Et encore, cet exemple est simple à départager. L’entreprise progresse notamment grâce aux cerveaux français qui travaillent aux pôles IA et apprentissage du langage naturel pour Facebook, mais on est encore loin d’avoir des résultats absolument positifs.

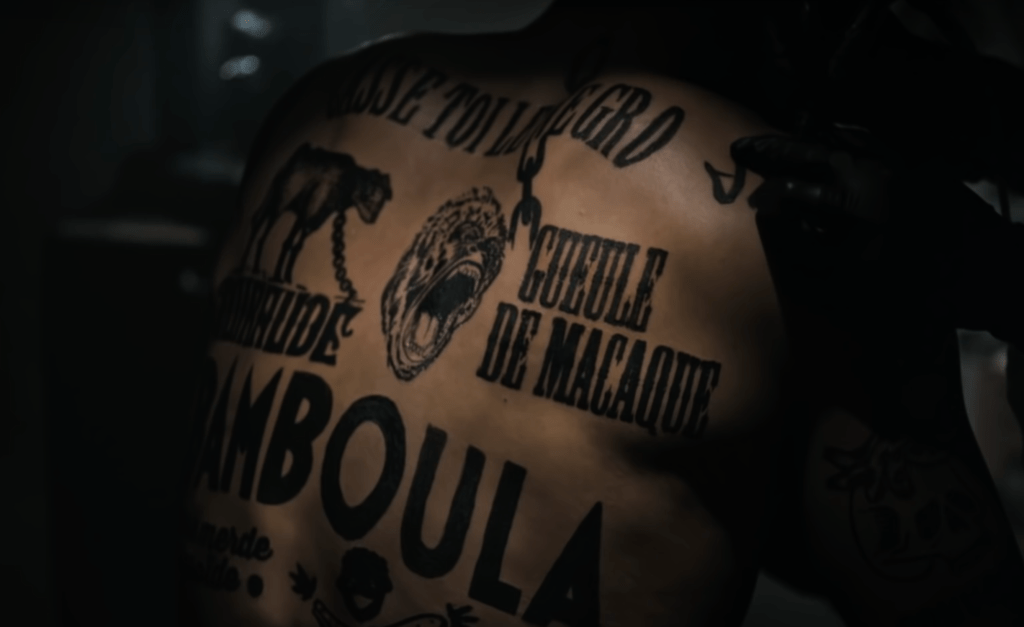

Lors d’un atelier donné à la suite de ces conférences, Facebook a invité le public à débattre du bien-fondé, ou non, d’une suppression de contenu sur le réseau social. L’idée était de montrer, avec plus ou moins de succès, que le métier de modérateur n’est pas simple et qu’il ne faut pas toujours crier à la censure quand il y a méprise.

Pour vous faire participer à ce débat, nous avons fait un petit quiz avec des exemples que nous avons pu voir. La question générale est simple : comment auriez-vous modéré ces publications si vous étiez Facebook ?

Dans la peau d’un modérateur

Correct !

Faux !

Correct !

Faux !

Correct !

Faux !

Inscrivez-vous pour voir vos résultats

Vous avez eu %%score%% bonne(s) réponse(s) !

Chargement...

Nouveauté : Découvrez

La meilleure expérience de Numerama, sans publicité,

+ riche,

+ zen,

+ exclusive.

Abonnez-vous gratuitement à Artificielles, notre newsletter sur l’IA, conçue par des IA, vérifiée par Numerama !