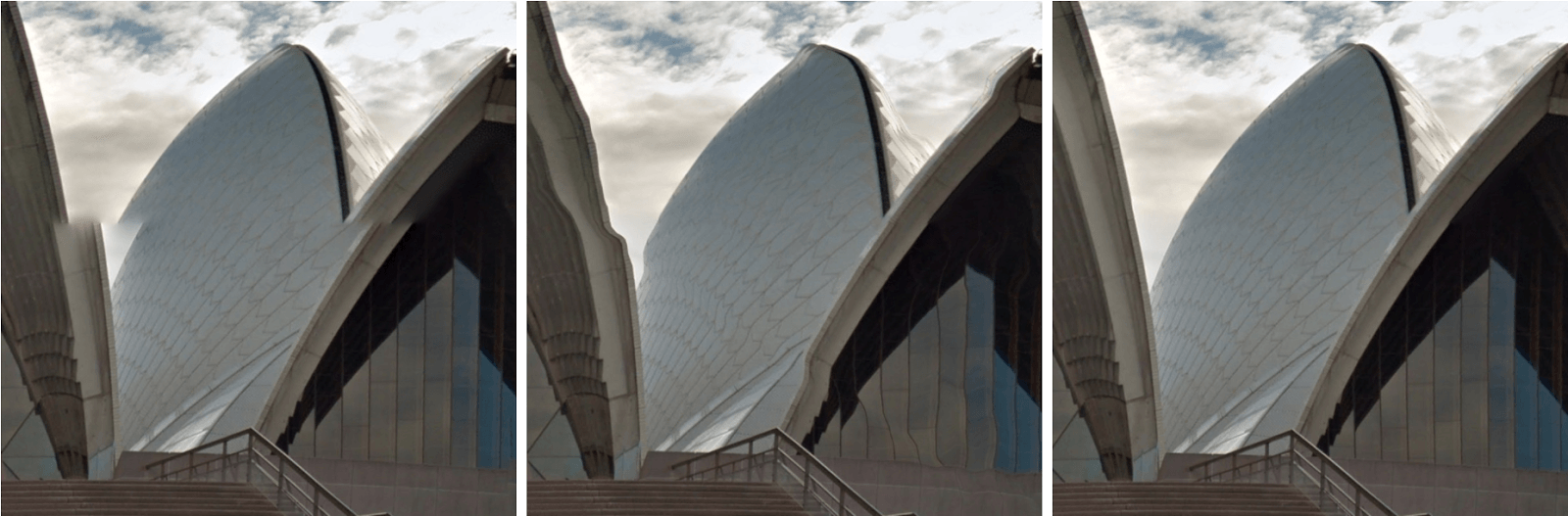

Vous l’avez peut-être déjà relevé en explorant les panoramas de Google Street View : les images sont parfois légèrement distordues ou décalées les unes par rapport aux autres. La faute à la superposition des clichés pour composer la vue à 360 degrés. Ainsi, une ligne droite peut être rompue ou une architecture de bâtiment marquer un curieux écart latéral.

Bien qu’il ne s’agisse pas d’un problème empêchant de profiter du service, le fait que Google ait décidé de le traiter montre qu’il ne s’agit pas d’un simple désagrément. La société a donc fini par mettre au point un nouvel algorithme, présenté sur son blog de recherche, qui sert à réaligner les images entre elles. Ce n’était pas simple, car il fallait éviter d’introduire de nouveaux problèmes.

« L’idée est de déformer subtilement chaque image de façon à ce que le contenu de l’image s’aligne au niveau des régions de chevauchement. Cela doit être fait avec prudence pour éviter d’introduire de nouveaux types d’artefacts visuels. L’approche doit également être taillée pour répondre aux variations de la géométrie de la scène, aux conditions d’éclairage, à la qualité de l’étalonnage et à bien d’autres conditions » explique ainsi Google.

Pour y parvenir, les ingénieurs ont fait appel à une discipline des mathématiques, l’optimisation globale, et à un phénomène de la vision, le flux optique. Le résultat est tout à fait spectaculaire, du moins sur les quelques exemples que la société utilise pour illustrer son propos.

Selon les ingénieurs, l’algorithme est désormais intégré à Street View pour lisser la superposition des photos.

Nouveauté : Découvrez

La meilleure expérience de Numerama, sans publicité,

+ riche,

+ zen,

+ exclusive.

Si vous avez aimé cet article, vous aimerez les suivants : ne les manquez pas en vous abonnant à Numerama sur Google News.