Dans une de ses publications Facebook, avant d’être elle-même bloquée, l’activiste lesbienne Gwen Fauchoix qualifiait de « week-end de censures homophobes » ce qu’elle a pu observer derrière ses écrans. En cause ? Une trentaine de comptes de militants et militantes LGBTQ+, la plupart activiste VIH-SIDA, ciblées par des suppressions de contenus ou des blocages pour être allées « à l’encontre des standards de la communauté ». Dans la majorité des cas, le mot « pédé » faisait partie des écrits visés. À la suite de nombreux articles (Médiapart, Les Inrocks, Libération ou encore Têtu) et signalements de la communauté, Facebook et Twitter se sont défendus de toute censure, en évoquant des « erreurs d’application ».

Mieux vaut prévenir que guérir ?

L’excès de zèle n’est pas nouveau sur les plateformes de réseaux sociaux. En 2014, une photo de deux femmes qui s’embrassent avec des drapeaux arc-en-ciel peints sur les joues était supprimée d’un compte d’une activiste LGBT+ italienne. En 2017, Twitter bloquait les recherches liées aux hashtags #bisexual et #gay avant de parler là encore d’une « erreur ». Ces deux termes étaient considérés comme pouvant être liés à du contenu « sensible » et entraînaient donc la suppression des messages.

La même année, YouTube bloquait de son côté des vidéos LGBT+, encore une fois parce que les comptes utilisant certains mots clés étaient identifiés comme du contenu violent ou pornographique. En parallèle, la CEO de YouTube Susan Wojcicki déclarait récemment à propos de contenus proprement homophobes : « Si l’on supprime ces contenus, le problème, c’est qu’il y aura beaucoup d’autres contenus qu’il faudra supprimer. Je pense que nous perdrions beaucoup de diversité d’opinions et je ne pense pas que ce soit une bonne solution », avant d’admettre qu’on trouvait sur sa plateforme de nombreux contenus ne respectant pas les règles du site.

Sur TikTok, les modérateurs avaient pour mission de signaler des utilisateurs et utilisatrices « jugé.es » LGBTQ+, handicapés ou gros comme potentiellement « vulnérables ». Des contenus ont été supprimés par anticipation d’un possible harcèlement. Pourquoi s’attaquer aux harceleurs quand on peut effacer les harcelés ? TikTok a reconnu, après l’enquête parue dans le média allemand Netzpolitik en décembre 2019 que « la démarche était mauvaise malgré de bonnes intentions ».

Dans une étude sur les discours de haine en ligne en France publiée en 2020, l’Institut pour le Dialogue Stratégique (ISD) écrit : « Les pages les plus actives sur Facebook semblaient toutes être soit des comptes officiels de plateformes médiatiques ou de journaux, soit des pages d’intérêt général qui ne semblaient pas utiliser de mots-clés anti-LGBTQ de façon haineuse. Ces constatations soulignent la difficulté d’identifier les pages haineuses à l’aide d’une approche basée sur des mots-clés dans les logiciels d’analyse disponibles sur le marché. » L’étude met aussi en avant l’utilisation de termes injurieux dans les logiques de réappropriation ou de contre-discours par certaines communautés.

Une loi contre-productive

Malgré les nombreuses alertes, jusqu’à l’ONU, la loi Avia a été votée le 13 mai 2020. Elle ne se positionne pas dans la lignée d’un contrôle plus juste ou réfléchi, mais laisse celui-ci aux mains d’entreprises dont les technologies ne sont pas encore assez performantes pour répondre aux exigences de délai de suppression de contenu (24h pour du contenu haineux, une heure pour des actes terroristes ou de la pédopornographie).

Dans son texte adressé au Conseil constitutionnel, qui doit encore rendre son avis, La Quadrature du Net insiste sur l’article 1 de la loi : « En l’espèce, aucun site ou hébergeur Web n’est techniquement capable de supprimer en une heure l’ensemble des contenus que l’administration est susceptible de lui signaler. » L’association interroge également la pertinence du délai d’une heure dans la lutte antiterroriste. D’autant que ni les discours haineux ni les « actes de terrorisme » ne sont explicitement définis par la loi Avia.

Iris Boyer a travaillé deux ans pour Facebook, puis YouTube. Elle est aujourd’hui responsable de programmes à l’ISD et a participé à l’étude citée sur les discours haineux en France. Bien qu’elle soutienne les efforts de régulation du numérique, elle avait déjà émis des réserves sur le projet de loi au moment de la mission préparatoire Avia-Amellal-Taieb. « Il y a un effet incitatif (louable) pour les plateformes à agir, mais a-t-on pesé toutes les variables pour être 100% sûr que cette loi n’aura pas plus d’effets pervers ? »

« Il n’y a aucune garantie sur l’infrastructure et les processus de contrôle pour que la loi Avia soit efficace »

Comme le souligne Iris Boyer, « cette loi a le mérite de pousser l’interopérabilité en matière de signalement, mais il n’y a pas d’harmonisation des critères de modération ou de curation des contenus entre les plateformes. Concernant leurs obligations, je trouve inquiétant qu’il n’y ait aucune garantie sur l’infrastructure et les processus de contrôle pour que la loi Avia soit efficace et qu’elle ne donne pas lieu à de la sur-censure automatisée. On demande aux plateformes de modérer à des échelles immenses, ce qui oblige à mixer l’humain au technologique. Là où c’est problématique, c’est qu’il faudrait que ce filtre soit toujours revu par des humains. » Or, dans les faits, la transparence n’est pas systématique et le processus loin d’être optimal.

« Il faut remettre l’humain au centre, des deux côtés de l’appréciation, insiste la chercheuse. À l’heure actuelle, on se concentre sur la création d’un cadre juridique qui se superpose aux choix commerciaux que les entreprises ont déjà fait. Alors qu’on pourrait réinventer collectivement les modalités de la modération en donnant plus de transparence et de liberté à l’utilisateur pour fixer lui-même ses seuils de tolérance dans les limites légales. L’enjeu, c’est celui de la transparence algorithmique : l’équilibre entre libre-arbitre et utilisation de la technologie au service de nos préférences. »

En 2018, les journalistes Jason Koebler et Joseph Cox dans leur enquête sur la modération de Facebook en 2018, qualifiaient déjà la modération de « job impossible ». Facebook admettait qu’ils n’étaient « pas liés aux lois internationales en matière de droits humains signées par les États » et que « que l’idée centrale était ici de savoir si une restriction particulière dans les discours était nécessaire à la prévention d’un préjudice ».

Un lieu sûr où tout le monde a sa voix ?

Il est vrai qu’un recours est possible. C’est d’ailleurs ce qu’ont fait les militants et militantes concerné.es pour récupérer l’accès à leur compte. Mais ils et elles ont tout de même été sans moyen d’expression durant plusieurs jours, du fait d’une erreur de jugement. Certains propos ont tout simplement disparu, comme ce tweet relayant une citation d’une émission de Radio Campus Paris, intitulée Le Lobby, sur Twitter, ou encore ces tweets (ci-dessous). critiques de la loi Avia.

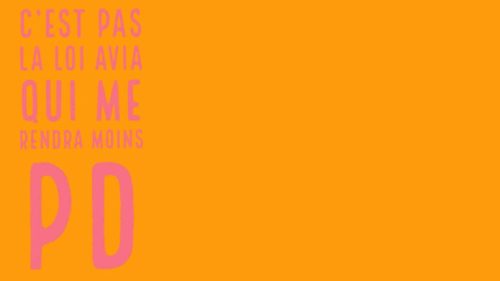

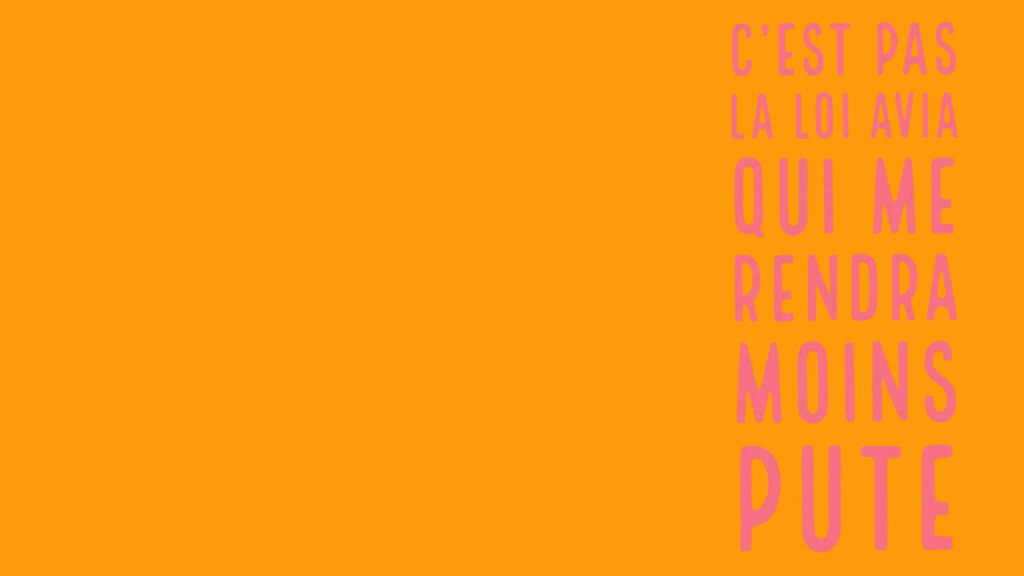

Parmi la dizaine de militants et militantes interrogées par Numerama, si beaucoup parlent de ne pas se taire, arborant fièrement des filtres tels que « C’est pas la loi Avia qui me rendra moins pédé/gouine/pute », d’autres au contraire se disent « cloisonné.es », « paranoïaques » (craignant un signalement d’un tiers homophobe) et forcés de pratiquer de l’autocensure de peur de disparaître.

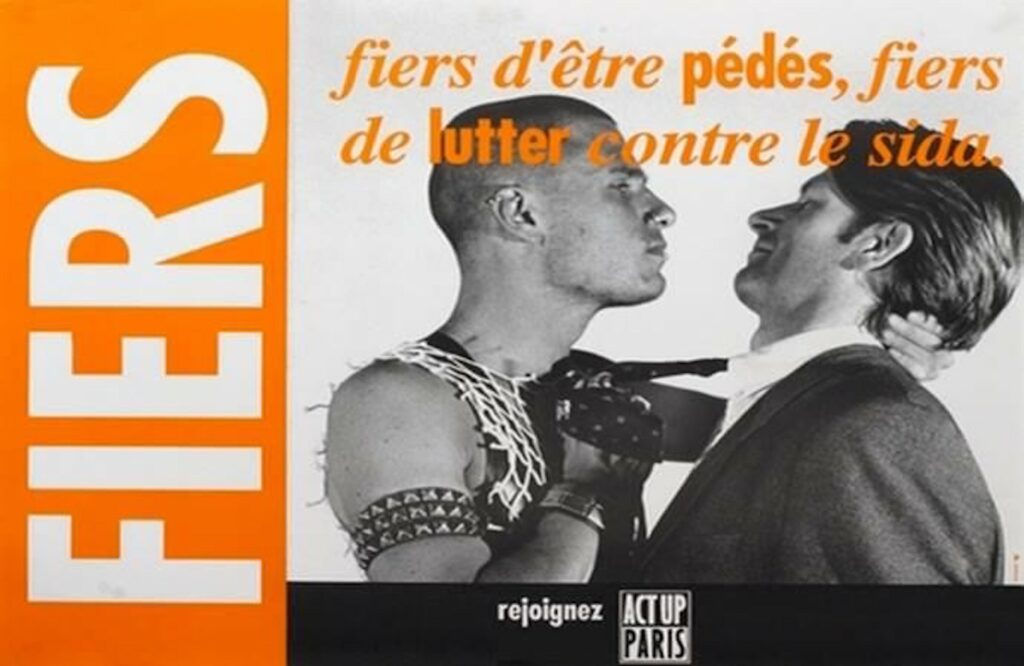

« On discutait des risques de la loi pour les travailleurs.ses du sexe, mais ça ne nous venait pas à l’esprit qu’ils puissent faire de la censure sur des mots qui sont dans nos tracts depuis les années 1990-2000 », réagit Pierre, secrétaire général d’Act-Up Paris, dont le compte a été bloqué pendant trois jours. « Je ne vois pas l’intérêt, ajoute Laurent, militant VIH-SIDA, qui en est à son quatrième compte Facebook. Il vaudrait mieux laisser tout visible, le vrai visage de l’homophobie doit être vu. »

Loi Avia ou non, les plateformes commerciales ont mis en place leurs propres règles, niant toujours des réalités et des vécus. La nouvelle fonctionnalité de Facebook, invitant les pages à se créer un nom d’utilisateur, refuse les mots « lesbienne », « lesbian » ou encore « bisexual »… L’ONG Eurocentralasian Lesbian Community en a récemment fait l’expérience : « J’ai mis ‘gay’ et là aucun souci. Alors que le mot ‘lesbian’ n’est pas accepté, parce qu’il est automatiquement une insulte pour Facebook », raconte Silvia Casalino, ingénieure spatiale et coprésidente. En 2019, Numerama montrait déjà comment Facebook n’aimait pas le mot « lesbienne ».

Drass, militante activiste LGBT+/VIH depuis 20 ans, a été bloquée pour sa photo de couverture contenant les termes « trans-pédé-gouine » écrits en tout petit sur fond rose : « Ce n’est pas normal d’être bloqué.e pour son identité, parce qu’elle ne rentre pas dans les standards hétéronormés. Donc ton identité est niée et déshumanisée par des algorithmes. C’est violent. »

Ces dernières semaines, la suppression en cascade, touchant un réseau d’activistes proches et engagés depuis plus de vingt ans (sans qu’on puisse vérifier l’origine du signalement), ne rassure pas sur l’avenir de la liberté d’expression sur internet, ni sur la capacité d’utiliser les outils « mainstream » pour les luttes militantes et l’accès aux différents publics. Comment toucher les personnes qui ont des addictions sans parler de drogue ? Comment sensibiliser sur le VIH sans parler de sexe ? Comment se réapproprier les insultes sans pouvoir les nommer ? Comment garantir le travail de recherches sans données ?

Sous couvert de régulation des discours haineux en ligne, la loi Avia rajoute une couche de flou sur un système rempli de failles, incapable de déceler l’ironie de l’injure. Dans ce contexte, la communauté LGBTQI+, luttant pour de la reconnaissance et de la visibilité se trouve particulièrement visée, à la fois censurée et attaquée parce qu’elle ne rentre pas dans les normes.

Nouveauté : Découvrez

La meilleure expérience de Numerama, sans publicité,

+ riche,

+ zen,

+ exclusive.

Abonnez-vous gratuitement à Artificielles, notre newsletter sur l’IA, conçue par des IA, vérifiée par Numerama !